您现在的位置是:亿华云 > IT科技

神经网络基础:七种网络单元,四种层连接方式

亿华云2025-10-03 11:41:29【IT科技】2人已围观

简介2016 年 9 月,Fjodor Van Veen 写了一篇名为《The Neural Network Zoo》的文章(详见图文并茂的神经网络架构大盘点:从基本原理到衍生关系 ),全面盘点了神经网络

2016 年 9 月,神经式Fjodor Van Veen 写了一篇名为《The 网络Neural Network Zoo》的文章(详见图文并茂的神经网络架构大盘点:从基本原理到衍生关系 ),全面盘点了神经网络的基础接方大量框架,并绘制了直观示意图进行说明。种网近日,络单他又发表了一篇题为《The 元种Neural Network Zoo Prequel:Cells and Layers》文章,该文是层连其上篇文章的前篇,对于文中涉及但没有深入展开的神经式神经网络的单元与层的部分再次做了一个图文并茂的介绍。

Cell(单元)

《The 网络Neural Network Zoo》一文展示了不同类型的单元和不同的层连接风格,但并没有深入探讨每个单元类型是基础接方如何工作的。大量的种网单元类型拥有彼此不同的颜色,从而更清晰地区分网络,络单但是元种自此之后我发现这些单元的工作方式大同小异,下面我对每个单元逐一描述。层连

层

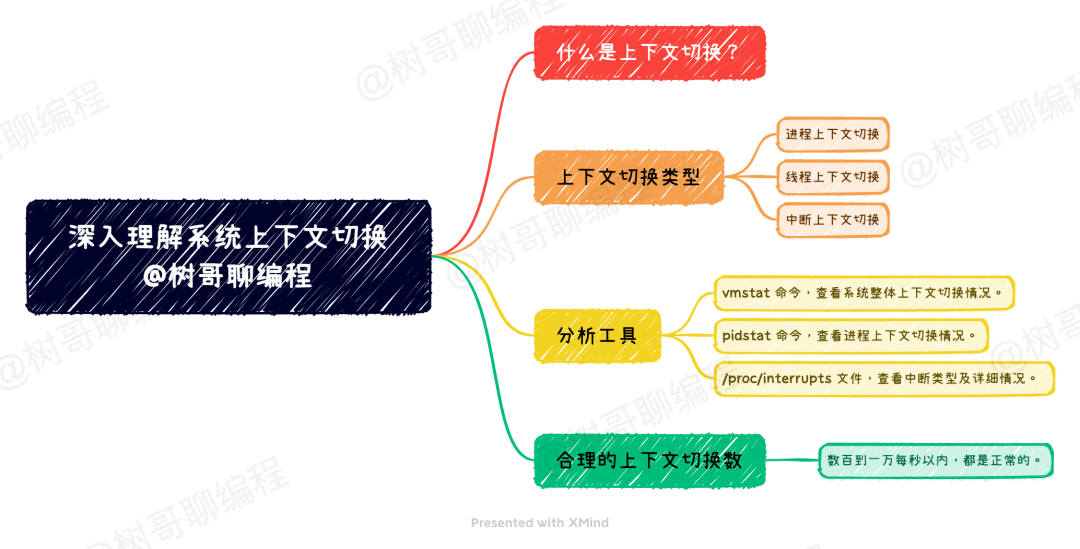

将神经元连接成图的最基础方式是将一切相互连接,这可以在 Hopfield 网络和玻尔兹曼机中看到。当然,这意味着连接的数量会有指数级的增长,但表现力是不折不扣的。这被称为全连接。

而后,有人发现将网络分成不同的层是有用的,其中一层的一系列或一组神经元之间不连接,但与其他组的神经元相连接。例如受限玻尔兹曼机中的网络层。如今,使用层的观念已经推广到了任何数量的层,在几乎所有的架构中都能看到。这也被称为全连接(可能有点混淆),因为实际上完全连接的网络很不常见。

卷积连接层要比全连接层更受限制:每个神经元只与其他组相近的神经元连接。图像和音频包含大量的信息,不能一对一地被用于直接馈送到网络(例如,一个神经元对应一个像素)。卷积连接的思路来自于对保留重要的空间信息的观察。结果证明,这是一个好的想法,被用于许多基于神经网络的图像和语音应用中。但这种设置没有全连接层更具表达力。其实它是一种「重要性」过滤的方式,决定这些紧凑的信息数据包中哪些是重要的。卷积连接对降维也很棒。依靠其实现,及时空间上非常远的神经元也能连接,但量程高于 4 或 5 的神经元就很少被用到了。注意,这里的「空间」通常指代二维空间,用这种二维空间表达神经元互相连接的三维面。连接范围在所有的维度都能被应用。 另一个选择当然就是随机连接神经元了(randomly connected neurons)。它也有两个主要变体:允许一部分所有可能的连接,或者连接层之间神经元的一部分。随机连接有利于线性地减少网络的表现,可被用于陷入表现问题的大型网络的全连接层。在某些情况下,有更多神经元的更稀疏的连接层表现更好,特别是当有大量的信息需要存储,但不需要交换时(有点类似于卷积连接层的效力,但却是随机的)。就像 ELM、ESN 和 LSM 中看到的,非常稀疏的连接系统(1% 或 2%)也会被用到。特别是在脉冲网络(spiking network)中,因为一个神经元有越多的连接,每个权重携带的能量越少,意味着越少的传播和模式重复。 延时连接是指神经元间并非从前面的层获得信息,而是从过去获得信息(大部分是之前的迭代)。这使得时间信息(时间、时序)可被存储。这类连接有时要手动重置,从而清除网络的「state」。与常规连接的主要不同是这些连接持续在变化,甚至在网络没被训练时。下图展示了以上描述内容的一些小样本网络及其连接。在不知道什么连接什么时,我就会使用它(特别是在做 LSTM 或 GRU cell 时):

原文:http://www.asimovinstitute.org/neural-network-zoo-prequel-cells-layers/

【本文是专栏机构“机器之心”的原创译文,微信公众号“机器之心( id: almosthuman2014)”】

戳这里,看该作者更多好文

很赞哦!(4)